EKS thường là nơi nhiều người gặp Kubernetes trên AWS lần đầu tiên. Video của TechWorld with Nana đi theo hướng rất thực tế: không sa đà vào triết lý, mà tập trung trả lời một câu hỏi đơn giản hơn nhiều, đó là làm sao tạo một Kubernetes cluster trên Amazon EKS theo cách dễ tiếp cận nhất.

Bài viết này tóm lược lại ý chính của video bằng tiếng Việt, đồng thời bổ sung thêm góc nhìn vận hành để người mới không lầm tưởng rằng tạo được cluster là đã hoàn thành phần khó nhất.

Bạn sẽ học được gì

- EKS là gì và phù hợp với tình huống nào

- một flow tạo cluster EKS đơn giản thường gồm những bước nào

- phần nào là AWS giúp bạn, phần nào bạn vẫn phải tự lo

- những lỗi tư duy thường gặp khi mới dùng EKS

- các bài nên đọc tiếp để nối sang kiến trúc container trên AWS

EKS thực chất là gì

Amazon EKS là dịch vụ managed Kubernetes của AWS. Cũng giống các managed service khác, EKS giúp bạn bỏ bớt gánh nặng dựng control plane và tích hợp Kubernetes với hệ sinh thái AWS tốt hơn. Điều hấp dẫn nhất của EKS không chỉ là tạo cluster nhanh, mà là kết nối được với IAM, VPC, load balancer, autoscaling và các dịch vụ khác trong cùng nền tảng.

Với team đã dùng AWS sẵn, điều này giúp hành trình vào Kubernetes mượt hơn nhiều so với việc tự dựng cụm trên EC2 từ đầu.

Một flow tạo EKS dễ hiểu

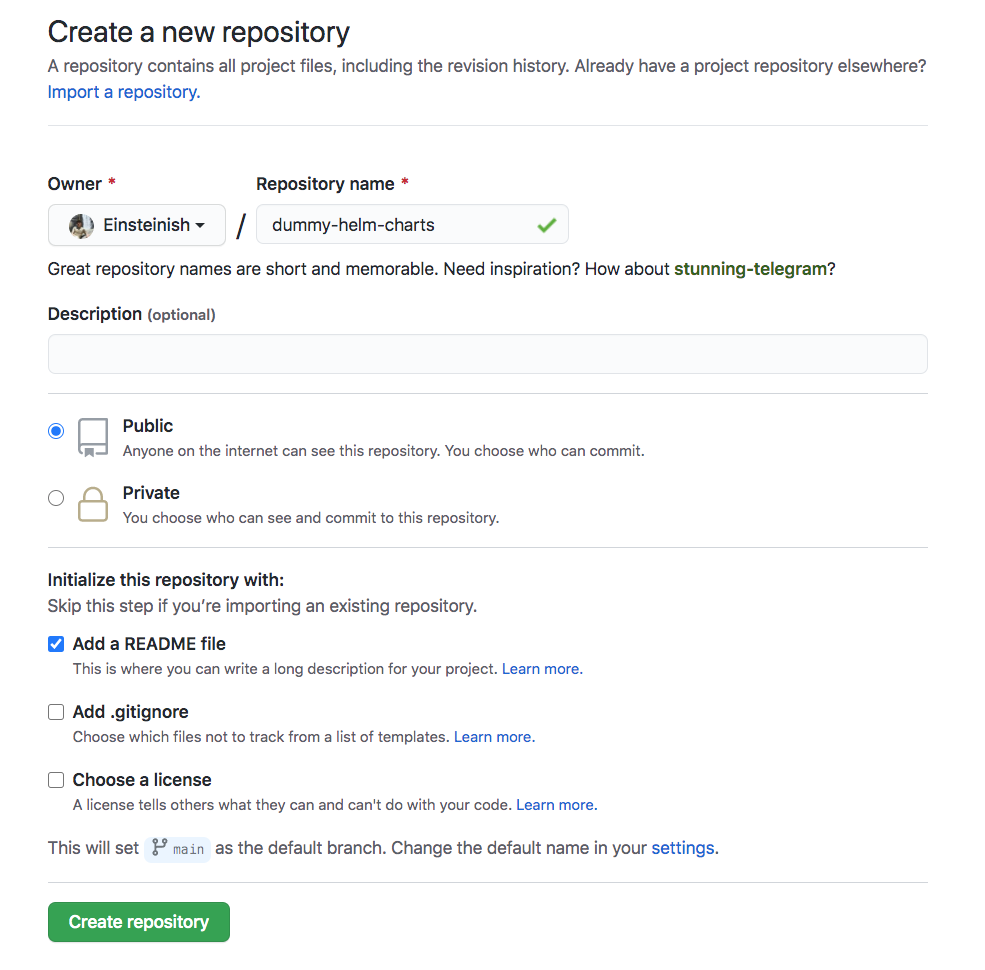

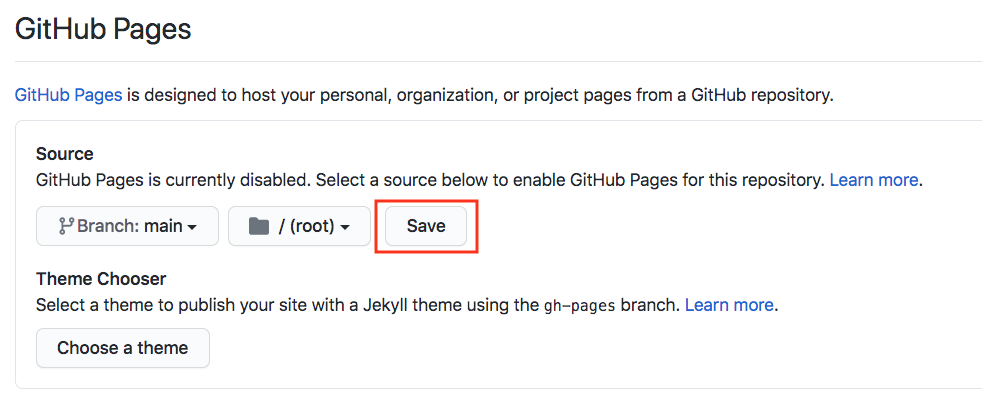

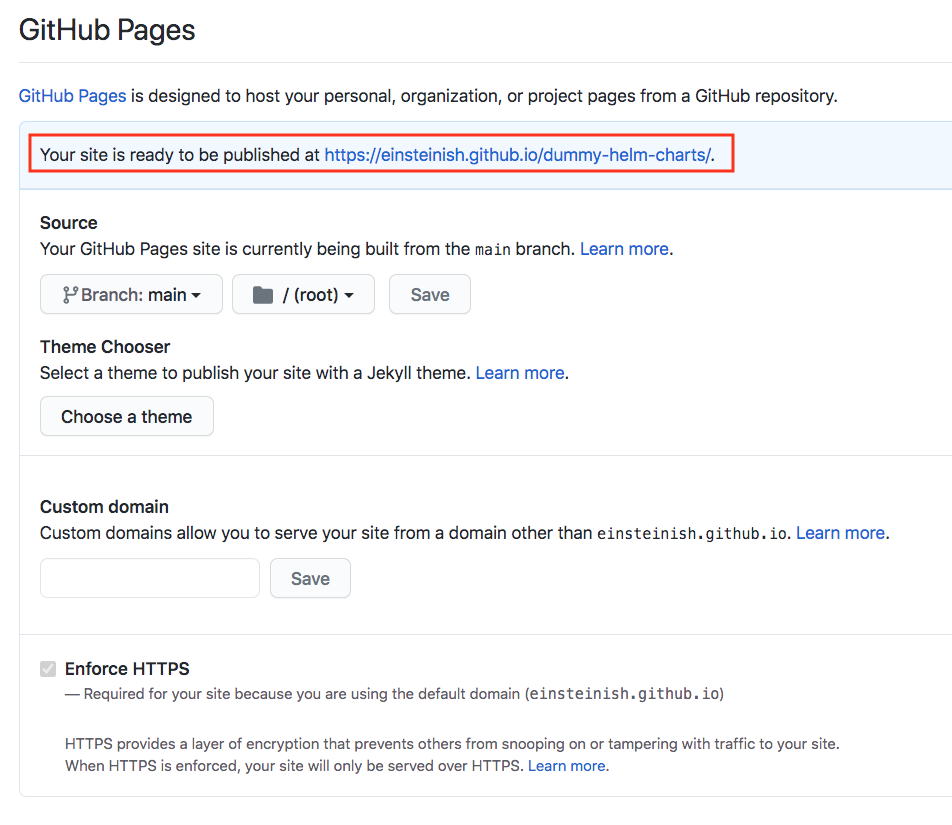

Nếu bỏ qua chi tiết nhỏ của từng câu lệnh, flow đơn giản để tạo EKS thường gồm:

- chuẩn bị tài khoản, region và quyền truy cập phù hợp

- tạo cluster EKS

- gắn worker node hoặc node group

- cấu hình `kubectl` để kết nối tới cluster

- triển khai ứng dụng thử nghiệm để xác minh môi trường hoạt động

Điểm quan trọng ở đây là cluster chỉ thật sự hữu ích khi có node để chạy workload. Nhiều người mới nhìn thấy cluster tạo thành công trong console và nghĩ mọi thứ đã sẵn sàng, nhưng nếu chưa có node group hợp lệ thì bạn vẫn chưa chạy được ứng dụng thực tế.

EKS giúp gì và không giúp gì

EKS giúp bạn đỡ phần control plane, tích hợp bảo mật theo cách quen thuộc của AWS, và tận dụng được nhiều dịch vụ xung quanh. Nhưng nó không tự động giải quyết toàn bộ bài toán nền tảng ứng dụng.

Bạn vẫn cần lo:

- chiến lược node và autoscaling

- thiết kế network và IAM cho workload

- quy trình CI/CD để đưa image vào cluster

- giám sát log, metric và alert

- kiểm soát chi phí khi môi trường mở rộng

Đây là lý do EKS phù hợp với tư duy platform engineering hoặc DevOps trưởng thành hơn là tư duy “bấm nút xong là có production”.

Vì sao EKS hấp dẫn với team AWS

EKS đặc biệt hấp dẫn khi hệ thống của bạn đã dùng VPC, IAM, CloudWatch, ECR hoặc các dịch vụ hạ tầng khác trên AWS. Khi đó, Kubernetes không phải một đảo tách biệt mà trở thành một phần của hệ sinh thái đang dùng.

Với người mới, đây là lợi thế lớn vì bạn không phải học lại mọi thứ từ đầu. Nhưng mặt trái là bạn cũng phải hiểu thêm nhiều khái niệm AWS hơn một cluster Kubernetes chung chung.

Những sai lầm thường gặp

- chỉ tập trung tạo cluster mà quên thiết kế node group hợp lý

- không kiểm soát IAM nên quyền quá rộng hoặc quá rối

- không dự trù chi phí cho worker node, load balancer và storage

- đưa workload lên EKS trước khi có logging và monitoring cơ bản

Nếu mới học, cách tốt nhất là bắt đầu từ một cụm nhỏ, một ứng dụng demo đơn giản, sau đó mới mở rộng dần các lớp như ingress, autoscaling và observability.

Tóm tắt nhanh

- EKS là managed Kubernetes service của AWS.

- Nó giúp bạn tăng tốc phần dựng cluster và tích hợp tốt hơn với hệ sinh thái AWS.

- Tạo được cluster chưa phải là xong, vì node, bảo mật, deploy và giám sát vẫn là phần việc lớn.

- EKS đặc biệt phù hợp khi team đã có nền tảng AWS từ trước.

Đọc tiếp

- Các lựa chọn container trên AWS để hiểu EKS đứng ở đâu trong bức tranh AWS.

- Managed Kubernetes cluster là gì để nắm tư duy managed cluster trước khi đi sâu vào EKS.

- Aws basics for engineers để nhìn lại nền tảng AWS căn bản.

- Kubernetes in practice nếu bạn muốn quay về bức tranh Kubernetes chung.

Nguồn tham khảo

- Video gốc: AWS EKS – Create Kubernetes cluster on Amazon EKS | the easy way

- Amazon EKS docs: https://docs.aws.amazon.com/eks/

- AWS ECR docs: https://docs.aws.amazon.com/AmazonECR/latest/userguide/what-is-ecr.html